Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

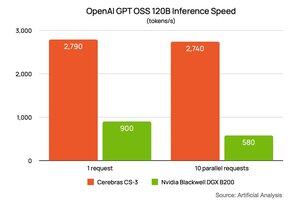

All'inizio di questa settimana, @NVIDIA ha condiviso le sue prestazioni sul modello gpt-oss-120B di @OpenAI in esecuzione su DGX B200 (8 chip Blackwell a due die). Hanno chiesto ad @ArtificialAnlys di fare un'analisi speciale per loro. Hanno mostrato prestazioni di 900 token al secondo per un utente, e sono scese a 580 token al secondo per 10 utenti. Ho incollato il loro link nei commenti qui sotto.

Abbiamo chiesto ad Artificial Analysis di eseguire la stessa configurazione per noi. Il risultato è di ~2700 token/s per 1 e lo stesso per 10 utenti. Non solo @CerebrasSystems Inference è il più veloce, ma manteniamo le prestazioni mentre aumenti il tuo carico di lavoro. Cerebras Inference è in piena produzione oggi, servendo miliardi di token GPT 120B a settimana su @OpenRouterAI, @huggingface e il Cerebras Cloud.

80,14K

Principali

Ranking

Preferiti