Tópicos populares

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

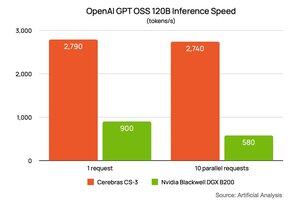

No início desta semana, @NVIDIA compartilhou seu desempenho no modelo gpt-oss-120B da @OpenAI rodando no DGX B200 (8 chips Blackwell de dois dies). Eles pediram à @ArtificialAnlys uma análise para fazer uma configuração especial para eles. Mostraram um desempenho de 900 tokens por segundo para um usuário, que caiu para 580 tokens por segundo para 10 usuários. Eu colei o link deles nos comentários abaixo.

Pedimos à Artificial Analysis para rodar a mesma configuração para nós. O resultado é ~2700 token/s para 1 e o mesmo para 10 usuários. Não só a Inference da @CerebrasSystems é a mais rápida, como também sustentamos o desempenho à medida que você aumenta sua carga de trabalho. A Inference da Cerebras está em plena produção hoje, servindo bilhões de tokens GPT 120B por semana no @OpenRouterAI, @huggingface e na Cerebras Cloud.

80,15K

Top

Classificação

Favoritos