Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

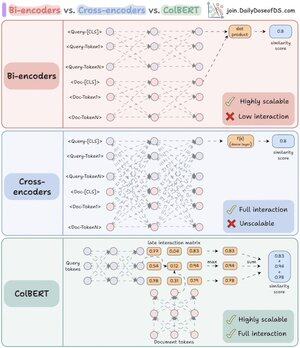

Eu finalmente entendi por que os re-rankers são tão poderosos quando entendi a principal diferença entre bi- e cross-encoders.

Além disso, encontrei uma maneira de combinar seus poderes usando uma arquitetura unificada.

Deixe-me explicar:

RAG é 80% de recuperação e 20% de geração. Portanto, se o RAG não estiver funcionando, provavelmente é um problema de recuperação.

É exatamente por isso que acertar sua arquitetura de recuperação é tão importante - e começa com a compreensão dessas duas (na verdade, três) abordagens de codificação.

(consulte o visual abaixo enquanto lê)

1️⃣ Bi-encoders

Os bicodificadores (a espinha dorsal da pesquisa vetorial) processam consultas e documentos separadamente.

- As incorporações de documentos são pré-computadas

- A consulta é incorporada no momento da pesquisa

Isso torna os bi-encoders perfeitos para recuperação inicial:

- extremamente rápido

- funciona em escala

- perde informações contextuais importantes

2️⃣ Codificadores cruzados

Os codificadores cruzados adotam uma abordagem completamente diferente para a reclassificação.

Eles processam a consulta e cada documento como uma única unidade.

- Combinar consulta com documento ([CLS] Consulta [SEP] Documento [SEP])

- Percorra o modelo juntos para atenção cruzada total

Isso torna os codificadores cruzados ideais para o segundo estágio:

- captura relações semânticas para melhor precisão

- mas muito mais lento e com muitos recursos para grandes coleções

Agora, e se pudermos combinar o melhor dos dois mundos!

3️⃣ ColBERT

O ColBERT reúne o poder dos codificadores cruzados e a escalabilidade dos bicodificadores.

- Codificar consultas e documentos separadamente

- Criar matriz de interação com pontuações de similaridade entre todos os pares de token de documento de consulta

- Obter pontuação máxima para cada token de consulta em tokens de documento

- Somar as pontuações máximas para a pontuação final correspondente

_____

Isso é tudo!

Se você achou perspicaz, compartilhe novamente com sua rede.

Encontre-me → @akshay_pachaar ✔️

Para obter mais insights e tutoriais sobre LLMs, agentes de IA e aprendizado de máquina!

46,69K

Melhores

Classificação

Favoritos