熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

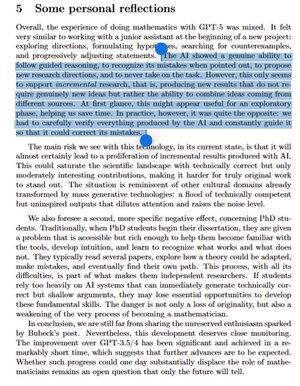

大型語言模型在其訓練集中的事物(在分佈內)或類似事物上絕對令人驚嘆。

對於超出訓練集的事物,經驗豐富的專家也能從中受益。在分佈的邊緣。

到目前為止,幾乎沒有突破超出分佈的證據。

9月8日 00:17

OpenAI 聯合創始人:「gpt-5 pro 用於新穎的數學——與一位數學教授合作」

數學家:「乍一看,這可能在探索階段看起來有用,幫助我們節省時間。然而,實際上卻恰恰相反」

> 似乎只支持增量研究

> 沒有真正的新想法

> 只是將來自不同來源的想法結合起來

> 「我們仍然遠未分享 @SebastienBubeck 文章所激發的毫無保留的熱情」

未來預測

> 將用技術上正確但僅僅中等有趣的貢獻飽和科學領域

> 使真正原創的工作更難以脫穎而出

> 「一波技術上合格但缺乏靈感的輸出稀釋了注意力」

> 博士生可能會失去發展基本技能的關鍵機會

> 不僅是原創性的喪失,還有成為數學家的過程本身的削弱

請不要上當於 OAI 的公關策略。

5.01K

熱門

排行

收藏