热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

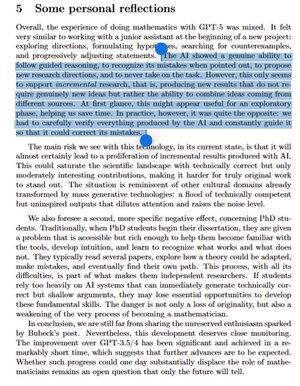

大型语言模型在其训练集中的事物(在分布内)或类似事物上绝对令人惊叹。

对于超出训练集的事物,经验丰富的专家也能从中受益。在分布的边缘。

到目前为止,几乎没有突破超出分布的证据。

9月8日 00:17

OpenAI 联合创始人:“gpt-5 pro 用于新颖的数学——与一位数学教授合作”

数学家:“乍一看,这可能在探索阶段看起来有用,帮助我们节省时间。然而,实际上却恰恰相反”

> 似乎只支持增量研究

> 没有真正的新想法

> 只是将来自不同来源的想法结合起来

> “我们仍然远未分享 @SebastienBubeck 文章所激发的毫无保留的热情”

未来预测

> 将用技术上正确但仅仅中等有趣的贡献饱和科学领域

> 使真正原创的工作更难以脱颖而出

> “一波技术上合格但缺乏灵感的输出稀释了注意力”

> 博士生可能会失去发展基本技能的关键机会

> 不仅是原创性的丧失,还有成为数学家的过程本身的削弱

请不要上当于 OAI 的公关策略。

5K

热门

排行

收藏