المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

لقد اكتشفنا للتو كيفية نقل تريليون معلمة بين وحدات معالجة الرسومات في 1.3 ثانية.

هذا تسريع 20 ضعفا مقارنة بالطرق التقليدية.

اسمحوا لي أن أوضح لكم كيف فعلنا ذلك:

منذ 10 ساعاتٍ

يعد نقل الوزن أحد أكبر الاختناقات عند إجراء RL الموزع على الطرز عالية السعة.

تشرح مدونة Perplexity Research الأولى الخاصة بنا كيف سخر مهندسو الاستدلال في Perplexity اتصال RDMA من نقطة إلى نقطة لفتح تحديثات المعلمات فائقة السرعة لنماذج تريليون معلمة.

من خلال تسخير أساسيات RDMA منخفضة المستوى والجدولة الثابتة وخطوط الأنابيب، نقوم بتسريع التحديثات بترتيب من حيث الحجم، إلى 1.3 ثانية فقط لكل تحديث.

1/ المشكلة

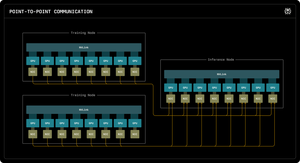

عند تدريب نماذج الذكاء الاصطناعي الضخمة مع التعلم المعزز ، فأنت بحاجة إلى مجموعتين منفصلتين لوحدة معالجة الرسومات تعملان معا: تدريب وحدات معالجة الرسومات التي تقوم بتحديث النموذج ، ووحدات معالجة الرسومات الاستدلالية التي تقوم بتشغيله.

بعد كل خطوة تدريبية ، يجب عليك نسخ كل تلك الأوزان المحدثة من التدريب إلى الاستدلال. بالنسبة لنماذج تريليون معلمة ، تستغرق معظم الأنظمة من 30 ثانية إلى عدة دقائق للقيام بذلك.

هذا عنق زجاجة هائل. قد تستغرق خطوة التدريب 5 ثوان ، ولكن بعد ذلك تنتظر 30 ثانية لنسخ الأوزان.

1/ المشكلة

عندما نقوم بتدريب نماذج الذكاء الاصطناعي الضخمة مع التعلم المعزز ، نحتاج إلى مجموعتين منفصلتين لوحدة معالجة الرسومات تعملان معا: تدريب وحدات معالجة الرسومات التي تقوم بتحديث النموذج ، ووحدات معالجة الرسومات الاستدلالية التي تقوم بتشغيله.

بعد كل خطوة تدريبية ، يتعين علينا نسخ كل تلك الأوزان المحدثة من التدريب إلى الاستدلال. بالنسبة لنموذج Kimi-K2 المكون من تريليون معلمة ، تستغرق معظم الأنظمة الحالية من 30 ثانية إلى عدة دقائق للقيام بذلك.

هذا عنق زجاجة هائل.

قد تستغرق خطوة التدريب لدينا 5 ثوان ، ولكن بعد ذلك سننتظر 30 ثانية لمجرد نسخ الأوزان. غير مقبولة.

2/ الطريقة القديمة

تقوم الأنظمة التقليدية بتحويل كل شيء من خلال وحدة معالجة رسومات واحدة "من المرتبة 0". ترسل جميع وحدات معالجة الرسومات التدريبية إلى وحدة معالجة رسومات رئيسية واحدة ، والتي ترسل إلى وحدة معالجة رسومات استدلالية واحدة ، والتي توزع على الباقي.

إنه مثل إجبار كل البريد على المرور عبر مكتب بريد واحد. يصبح هذا الاتصال هو عنق الزجاجة - يقتصر على حوالي 50 غيغابايت في الثانية.

كنا نعلم أنه يجب أن تكون هناك طريقة أفضل.

3 / اختراقنا

حلنا: RDMA WRITE - الوصول المباشر إلى الذاكرة عن بعد.

باستخدام RDMA ، يمكن لوحدات معالجة الرسومات التدريبية الخاصة بنا الكتابة مباشرة في ذاكرة GPU الاستدلالية. لا وسيط. لا طلب إذن. نحن فقط ننقل البيانات مباشرة إلى ذاكرة الوصول العشوائي لجهاز كمبيوتر آخر.

لا يتم إخطار وحدة معالجة الرسومات المستلمة. إنها عملية "أحادية الجانب".

وإليك المفتاح: تتحدث كل وحدة معالجة رسومات تدريبية مباشرة إلى كل وحدة معالجة رسومات استدلالية. كل ذلك دفعة واحدة. في موازاة ذلك. نقوم بتشبع نسيج الشبكة بالكامل بدلا من عنق الزجاجة على رابط واحد.

نستخدم أيضا خطوط الأنابيب - تقسيم التحويلات إلى مراحل متداخلة بحيث تظل موارد الأجهزة المختلفة مشغولة في وقت واحد.

بالإضافة إلى ذلك ، نقوم بحساب جدول النقل مرة واحدة عند بدء التشغيل وإعادة تشغيله فقط. لا يوجد تخطيط متكرر للنفقات العامة.

4/ نتائجنا

بالنسبة إلى Kimi-K2 مع 1 تريليون معلمة: 1.3 ثانية للنقل من 256 وحدة معالجة رسومات تدريبية إلى 128 وحدة معالجة رسومات استدلالية.

هذا ينقل حوالي 2 تيرابايت من البيانات في ما يزيد قليلا عن ثانية. عبر شبكة. بين الآلات.

عندما نحرق آلاف الدولارات في الساعة على مجموعات GPU ، فإن القضاء على عنق الزجاجة هذا يعني توفيرا هائلا في التكاليف ودورات تكرار أسرع.

4/ نتائجنا

بالنسبة إلى Kimi-K2 مع 1 تريليون معلمة: 1.3 ثانية للنقل من 256 وحدة معالجة رسومات تدريبية إلى 128 وحدة معالجة رسومات استدلالية.

هذا ينقل حوالي 2 تيرابايت من البيانات في ما يزيد قليلا عن ثانية. عبر شبكة. بين الآلات.

عندما نحرق آلاف الدولارات في الساعة على مجموعات GPU ، فإن القضاء على عنق الزجاجة هذا يعني توفيرا هائلا في التكاليف ودورات تكرار أسرع.

5 / لماذا يهم

الجزء الأنيق؟ لم نخترع أجهزة جديدة. لقد استخدمنا للتو تقنية RDMA الحالية مع هندسة الأنظمة الذكية.

في بعض الأحيان ، لا تتعلق أفضل الحلول باختراع شيء جديد - إنها تتعلق باستخدام الأدوات الحالية بشكل جيد حقا.

هذه هي الطريقة التي نبني بها في الحيرة.

هذه هي نظرة عامة عالية المستوى لنظام نقل الوزن لدينا. لكنني متأكد من أن لديك جميعا أسئلة ، أليس كذلك؟

اسألني أي شيء.

74.62K

الأفضل

المُتصدِّرة

التطبيقات المفضلة