Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

почему бы нам не провести предварительное обучение моделей для агентных задач?

ну, эти ребята сделали это. и это сработало.

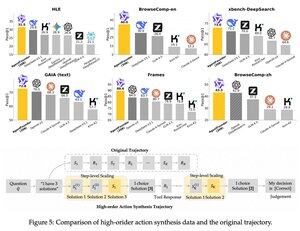

они ввели промежуточный этап после предварительного обучения и перед постобучением. они синтезировали данные действий агентов, и их модель AgentFounder-30B устанавливает новый SOTA по 10 бенчмаркам.

SFT также имеет значительно меньшую потерю после этого шага агентного непрерывного предварительного обучения.

почему это работает?

потому что универсальные базовые модели обычно не имеют агентного индуктивного смещения, что возлагает бремя на постобучение.

когда вы вводите многоступенчатое рассуждение и использование инструментов на этапе предварительного обучения, вы облегчаете путь для постобучения, особенно когда вы делаете это с помощью смеси коротких и долгосрочных агентных задач.

так что это значит, если вы ведете свой бизнес на агентах или строите их в любом масштабе?

вы можете синтезировать данные с низкими затратами, дополнительно предварительно обучить базовую модель, а затем провести постобучение.

Топ

Рейтинг

Избранное