المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

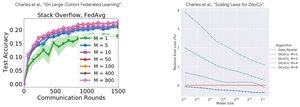

تحليل الأداء: DiLoCo مقابل التعلم الموحد

نتيجة غير بديهية: يزداد أداء DiLoCo سوءا مع المزيد من النسخ المتماثلة (M ↑ = الأداء ↓) ، بينما يتحسن التعلم الموحد مع المزيد من العملاء (M ↑ = الأداء ↑)

لماذا الاتجاهات المعاكسة؟

DiLoCo: ميزانية البيانات الثابتة تقسيم M طرق. المزيد من النسخ المتماثلة = بيانات أقل لكل نسخة متماثلة. ومن ثم ، يظل إجمالي الحوسبة ثابتا (تحليل isoflop) ويرى كل عامل بيانات D / M = تعلم أسوأ

التعلم الموحد: يجلب كل عميل بيانات جديدة. المزيد من العملاء = المزيد من مجموعات البيانات الفريدة الإجمالية. يضيف كل عميل كلا من بيانات الحوسبة والبيانات الجديدة. وبالتالي ، ينمو إجمالي البيانات: D₁ + D₂ + ... + Dm = تعلم أفضل

الرؤية الرئيسية: لا يتعلق الأمر بالخوارزمية - إنه يتعلق بقيود الموارد!

بفضل الحديث المفيد عن @MatharyCharles في Scratch to Scale ، تعلمت الكثير عن DiLoCo و Federated Learning.

إذا كنت مهتما بمعرفة المزيد عن DiLoCo والتدريب الموزع والاستدلال والتوازي ، فراجع فئة Scratch to Scale في @TheZachMueller أو أي من هذه الموارد أدناه:

المصادر:

ديلوكو:

التعلم الموحد:

خدش إلى مقياس:

#MachineLearning #DistributedTraining #الذكاء الاصطناعي

الأفضل

المُتصدِّرة

التطبيقات المفضلة