Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

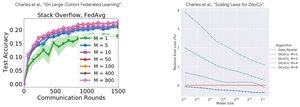

Análise de desempenho: DiLoCo vs Federated Learning

Descoberta contra-intuitiva: o desempenho do DiLoCo fica PIOR com mais réplicas (M↑ = desempenho↓), enquanto o Aprendizado Federado fica MELHOR com mais clientes (M↑ = desempenho↑)

Por que as tendências opostas?

DiLoCo: Orçamento de dados fixo dividido de M maneiras. Mais réplicas = Menos dados por réplica. Portanto, a computação total permanece constante (análise de isoflops) e cada trabalhador vê dados D/M = pior aprendizado

Aprendizagem Federada: Cada cliente traz NOVOS dados. Mais clientes = Mais conjuntos de dados exclusivos totais. Cada cliente adiciona dados de computação E dados atualizados. Assim, o total de dados cresce: D₁ + D₂ + ... + Dm = melhor aprendizagem

Insight principal: Não é sobre o algoritmo - é sobre as restrições de recursos!

Graças à palestra esclarecedora de @MatharyCharles em Scratch to Scale, aprendi muito sobre DiLoCo e Federated Learning .

Se você estiver interessado em aprender mais sobre DiLoCo, treinamento distribuído, inferência e paralelismo, confira a aula Scratch to Scale da @TheZachMueller ou qualquer um desses recursos abaixo:

Fontes:

DiLoCo:

Aprendizagem Federada:

Scratch para escalar:

#MachineLearning #DistributedTraining #AI

Melhores

Classificação

Favoritos