Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

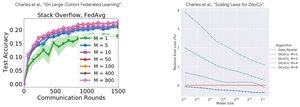

Análisis de rendimiento: DiLoCo vs aprendizaje federado

Hallazgo contraintuitivo: el rendimiento de DiLoCo empeora con más réplicas (M↑ = rendimiento↓), mientras que el aprendizaje federado mejora con más clientes (M↑ = rendimiento↑)

¿Por qué las tendencias opuestas?

DiLoCo: Presupuesto de datos fijos dividido M formas. Más réplicas = Menos datos por réplica. Por lo tanto, el cómputo total permanece constante (análisis isoflop) y cada trabajador ve datos D/M = peor aprendizaje

Aprendizaje federado: Cada cliente aporta NUEVOS datos. Más clientes = Más conjuntos de datos únicos totales. Cada cliente agrega datos informáticos y nuevos. Por lo tanto, los datos totales crecen: D₁ + D₂ + ... + Dm = mejor aprendizaje

Idea clave: No se trata del algoritmo, ¡se trata de las limitaciones de recursos!

Gracias a la charla esclarecedora de @MatharyCharles en Scratch to Scale, he aprendido mucho sobre DiLoCo y el aprendizaje federado.

Si está interesado en obtener más información sobre DiLoCo, entrenamiento distribuido e inferencia y paralelismo, consulte la clase Scratch to Scale de @TheZachMueller o cualquiera de estos recursos a continuación:

Fuentes:

DiLoCo:

Aprendizaje federado:

Scratch a escala:

#MachineLearning #DistributedTraining #AI

Populares

Ranking

Favoritas