Trendaavat aiheet

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

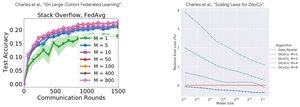

Suorituskykyanalyysi: DiLoCo vs federoitu oppiminen

Ristiriitainen havainto: DiLoCo:n suorituskyky huononee, kun kopioita on enemmän (M↑ = suorituskyky↓), kun taas federoitu oppiminen paranee useammilla asiakkailla (M↑ = suorituskyky↑)

Miksi päinvastaiset suuntaukset?

DiLoCo: Kiinteä databudjetin jako M tapaa. Enemmän replikoita = vähemmän tietoja replikaa kohden. Näin ollen kokonaislaskenta pysyy vakiona (isoflop-analyysi) ja jokainen työntekijä näkee D/M-datan = huonomman oppimisen

Federoitu oppiminen: Jokainen asiakas tuo UUTTA tietoa. Enemmän asiakkaita = Enemmän yksilöllisiä tietojoukkoja. Jokainen asiakas lisää sekä laskentatietoja ETTÄ tuoreita tietoja. Näin ollen kokonaisdata kasvaa: D₁ + D₂ + ... + Dm = parempi oppiminen

Keskeinen oivallus: Kyse ei ole algoritmista - vaan resurssien rajoituksista!

Scratch to Scalen @MatharyCharles valaisevan puheen ansiosta olen oppinut paljon DiLoCo:sta ja Federated Learningista.

Jos olet kiinnostunut oppimaan lisää DiLoCo:sta, hajautetusta koulutuksesta ja päättelystä ja rinnakkaisuudesta, tutustu @TheZachMueller:n Scratch to Scale -luokkaan tai johonkin seuraavista resursseista:

Lähteistä:

DiLoCo:

Federoitu oppiminen:

Naarmuuntuminen mittakaavaan:

#MachineLearning #DistributedTraining #AI

Johtavat

Rankkaus

Suosikit