Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

DailyHealthcareAI

Berbagi makalah penelitian dan berita tentang aplikasi AI dalam radiologi, patologi, genetika, desain protein, dan banyak lagi. Mari belajar bersama!

🚀David Baker preprint dari @UWproteindesign 👇👇

Apa yang membuat pemotongan ikatan protein begitu menantang sehingga alam mengembangkan enzim khusus dengan kofaktor logam untuk mencapainya?@biorxivpreprint @ETH_en

"Desain komputasi protease sistein"

• Ikatan amida dalam protein memiliki waktu paruh ratusan tahun dalam kondisi fisiologis, membuatnya jauh lebih stabil daripada ikatan ester (dengan gugus meninggalkan amina memiliki pKa >35 versus <8 untuk ester aktif), dan desain enzim komputasi sebelumnya hanya berhasil dengan substrat ester molekul kecil yang diaktifkan daripada pembelahan ikatan peptida yang menuntut energik yang diperlukan untuk protease.

• Para peneliti menggunakan RoseTTAFold Diffusion 2 for Molecular Interfaces (RFD2-MI) untuk merancang protease seng dari motif katalitik minimal, membangun situs aktif yang ideal dengan lima gugus fungsional (tiga residu pengikat seng H1, H2, E1, satu basa katalitik E2, dan satu tirosin penstabil oksianion Y) berdasarkan struktur aminopeptidase N dan astacin, melakukan desain dua sisi dari urutan protease dan substrat untuk memastikan posisi yang tepat dari ikatan amida target.

• Dari 135 desain yang diuji dalam satu putaran desain, 36% menunjukkan aktivitas (14,7% untuk model Zn-saja dan 87,5% untuk model Zn-air), dengan semua desain aktif membelah dengan tepat di lokasi yang dimaksudkan yang dikonfirmasi oleh spektrometri massa; desain paling aktif (Zn45 membelah substrat ZnO36) mencapai kcat 0,025 ± 0,002 s⁻¹, KM 26 ± 5 μM, dan kcat/KM 900 ± 200 M⁻¹s⁻¹, mewakili percepatan laju >10⁸ kali lipat atas hidrolisis yang tidak dikatalisis; desain menunjukkan pengikatan seng dengan Kd antara 10⁻¹⁰ dan 10⁻⁸ M, menunjukkan spesifisitas substrat pada 4 dari 5 perancah, dan dapat diprogram ulang untuk membelah protein TDP-43 manusia yang relevan dengan penyakit dengan 4 varian mencapai pembelahan ≥80% pada 5 jam.

Penulis: Hojae Choi et. al Donald Hilvert, Samuel J. Pellock, David Baker

Tautan:

625

Bisakah model bahasa mempelajari struktur RNA tanpa data pelatihan struktural eksplisit?@NatureComms @Tsinghua_Uni

"ERNIE-RNA: model bahasa RNA dengan representasi yang ditingkatkan struktur"

• Model bahasa RNA yang ada mengabaikan informasi struktural dalam urutan, yang mengarah pada ekstraksi fitur yang tidak lengkap dan kinerja yang tidak optimal, meskipun organisasi hierarkis RNA di mana urutan primer dilipat menjadi konformasi struktural tertentu yang menentukan fungsi biologis. Pendekatan komputasi tradisional untuk prediksi struktur RNA menghadapi tantangan yang berbeda: metode berbasis termodinamika dibatasi oleh akurasi parameter, metode berbasis penyelarasan berjuang tanpa urutan homolog yang memadai, dan model pembelajaran mendalam menunjukkan generalisasi terbatas ke keluarga RNA yang tidak terlihat. Sementara model bahasa RNA gaya BERT seperti RNA-FM (dilatih pada 23 juta urutan), UNI-RNA (1 miliar urutan, parameter 400M), dan RiNALMo (urutan 36M, parameter 650M) telah muncul, mereka gagal menggabungkan informasi struktural secara memadai, dengan beberapa seperti UTR-LM mencoba mengatasi ini dengan menggabungkan struktur yang diprediksi dari RNAfold tetapi menghadapi keterbatasan dari kesalahan prediksi dan berkurangnya kemampuan generalisasi.

• ERNIE-RNA adalah model bahasa pra-terlatih RNA 86 juta parameter berdasarkan arsitektur BERT yang dimodifikasi dengan 12 blok transformator dan 12 kepala perhatian, dilatih pada 20,4 juta urutan RNA non-coding dari RNAcentral setelah menyaring urutan yang lebih panjang dari 1022 nukleotida dan menerapkan penghapusan redundansi CD-HIT pada kesamaan 100%. Model ini menggabungkan mekanisme bias perhatian yang diinformasikan pasangan dasar yang menetapkan nilai 2 untuk pasangan AU, 3 untuk pasangan CG, dan parameter yang dapat disetel α (awalnya 0,8) untuk pasangan GU dalam matriks posisi berpasangan semua-lawan-semua, menggantikan istilah bias di lapisan transformator pertama. Pra-pelatihan menggunakan pemodelan bahasa bertopeng dengan 15% token diganti secara acak, dilatih selama 20 hari pada 24 GPU 32G-V100 menggunakan fairseq dengan tingkat pembelajaran dasar 0,0001, 20.000 langkah pemanasan, dan peluruhan bobot 0,01, menghasilkan peta perhatian (L×L×156) dan penyematan token (12×768×L) sebagai output.

• Peta perhatian ERNIE-RNA menunjukkan kemampuan prediksi struktur sekunder RNA nol-tembakan dengan skor F1 rata-rata 0,552 pada set uji bpRNA-1m, mengungguli RNAfold (0,492), struktur RNA (0,491), RNAErnie (0,440), dan RNA-BERT (0,365) tanpa penyetelan halus. Setelah penyempurnaan, ERNIE-RNA mencapai skor F1 rata-rata makro canggih sebesar 0,873 pada bpRNA-1m, melampaui RiNALMo (0,850, 650M parameter) dan UNI-RNA (0,821, 400M parameter), dengan kepemimpinan serupa pada ArchiveII (0,954 vs RiNALMo 0,892) dan RIVAS TestSetB (0,721 vs RiNALMo 0,555). Pada tes generalisasi lintas keluarga yang menantang, ERNIE-RNA beku mencapai skor F1 0,646 pada bpRNA-new dan 0,590 pada RNA3DB-2D, mengungguli metode pemrograman dinamis tradisional seperti Eternafold (0,639) dan mempertahankan keunggulan atas semua pesaing pembelajaran mendalam. ERNIE-RNA juga mencapai kinerja unggul di berbagai tugas hilir: prediksi peta kontak RNA dengan presisi Top-L/1 0,68 (vs ansambel RNAcontact pada 0,46), prediksi MRL 5'UTR dengan R² 0,92 pada set uji acak dan 0,86 pada set uji manusia, prediksi pengikatan RNA-protein mengungguli semua metode yang diuji, akurasi klasifikasi keluarga ncRNA 0,9844 (0% kebisingan batas) dan 0,9820 (200% kebisingan batas), skor F1 prediksi situs sambungan mulai dari 0,9180 hingga 0,9612 di empat spesies, akurasi top-K 55,37% pada kumpulan data SpliceAI (vs RNA-FM 34,84%), dan prediksi poliadenilasi alternatif R² 78,39% (vs RNA-FM 70,32%).

Penulis: Weijie Yin, Zhaoyu Zhang, Shuo Zhang, Liang He et. al Xuegong Zhang, Tao Qin & Zhen Xie

Tautan:

655

Bisakah kecerdasan buatan merancang peptida terapeutik dengan meniru bagaimana protein alami mengikat target penyakit?@Tsinghua_Uni @natBME

"Desain peptida melalui mimikri antarmuka pengikatan dengan PepMimic"

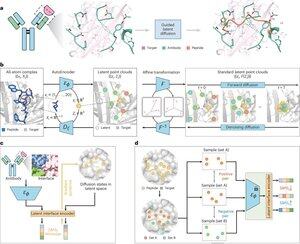

• Para peneliti mengembangkan PepMimic, algoritma AI yang menggabungkan autoencoder semua atom, model difusi laten, dan encoder antarmuka untuk merancang peptida (4-25 asam amino) yang meniru antarmuka pengikatan antara protein target dan pengikat yang diketahui seperti antibodi atau reseptor, mengatasi keterbatasan dalam desain peptida saat ini yang membutuhkan keahlian manual dan berjuang dengan permukaan pengikatan terputus-putus.

• Lebih dari 80 terapi peptida disetujui untuk penyakit termasuk diabetes dan kanker, menawarkan keuntungan seperti spesifisitas tinggi, toksisitas yang lebih rendah, dan pemberian oral potensial dibandingkan dengan molekul kecil dan biologis, namun merancang peniru peptida dari interaksi protein-protein secara tradisional membutuhkan keahlian yang luas dan tidak dapat secara efektif menangani antarmuka pengikatan terputus-putus, sementara model AI yang ada berfokus pada pendekatan tulang punggung kemudian urutan daripada menangkap rantai samping yang penting geometri untuk interaksi asam amino yang akurat.

• PepMimic dilatih pada 4.157 kompleks protein-peptida dan 70.645 fragmen seperti peptida dari Bank Data Protein, menggunakan autoencoder untuk memetakan geometri semua atom ke ruang laten, model difusi untuk 100 langkah denoising, dan pembelajaran kontras untuk melatih encoder antarmuka yang memandu generasi dengan meminimalkan jarak antara antarmuka yang dirancang dan referensi di ruang laten, dengan kandidat diberi peringkat menggunakan energi antarmuka Rosetta, Energi FoldX, metrik hit antarmuka, dan skor pLDDT AlphaFold Multimer sebelum memilih peptida teratas (384 untuk target dengan pengikat yang diketahui, 94-290 untuk pengikat yang dihasilkan AI) untuk eksperimen pencitraan resonansi plasmon permukaan.

• PepMimic mencapai AUROC rata-rata 0,71 di 31 tugas pada 93 kompleks uji (mengungguli RFDiffusion 0,69), merancang 384 peptida untuk 5 target obat (PD-L1, CD38, BCMA, HER2, CD4) dengan 8% mencapai KD < 100 nM dan 26 peptida mencapai KD pada tingkat 10⁻⁹ M (secara substansial lebih tinggi dari penyaringan perpustakaan acak), menghasilkan peptida meniru pengikat yang dirancang AI untuk CD38 dan TROP2 dengan tingkat keberhasilan 14% (16% untuk CD38, 8% untuk TROP2), dan menunjukkan penargetan tumor in vivo yang efektif pada model tikus dengan peptida terpilih yang menunjukkan penyerapan 8,85 kali lebih besar pada tumor PD-L1-positif dan penyerapan 16,18 kali lebih besar pada tumor TROP2-positif, mencapai tingkat keberhasilan 20.000-90.000 kali lebih tinggi daripada skrining perpustakaan acak eksperimental.

Penulis: Xiangzhe Kong et. al Zihua Wang, Yang Liu & @musicsuperman

Tautan:

1,26K

Teratas

Peringkat

Favorit