Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

DailyHealthcareAI

Udostępnianie artykułów naukowych i wiadomości na temat zastosowań sztucznej inteligencji w radiologii, patologii, genetyce, projektowaniu białek i wielu innych. Uczmy się razem!

🚀David Baker preprint z @UWproteindesign 👇👇

Co sprawia, że cięcie wiązań białkowych jest tak trudne, że natura wyewoluowała wyspecjalizowane enzymy z metalowymi kofaktorami, aby to osiągnąć?@biorxivpreprint @ETH_en

"Obliczeniowe projektowanie proteaz cysteinowych"

• Wiązania amidowe w białkach mają okresy półtrwania liczone w setkach lat w warunkach fizjologicznych, co czyni je znacznie bardziej stabilnymi niż wiązania esterowe (z grupami odchodzącymi aminowymi mającymi pKa >35 w porównaniu do <8 dla aktywowanych estrów), a wcześniejsze obliczeniowe projektowanie enzymów zakończyło się sukcesem tylko z aktywowanymi substratami małych cząsteczek estrów, a nie z energetycznie wymagającym rozkładem wiązań peptydowych wymaganym dla proteaz.

• Naukowcy użyli RoseTTAFold Diffusion 2 dla Interfejsów Molekularnych (RFD2-MI) do zaprojektowania proteaz cynkowych z minimalnych motywów katalitycznych, konstruując idealne miejsce aktywne z pięcioma grupami funkcyjnymi (trzy reszty wiążące cynk H1, H2, E1, jedna zasada katalityczna E2 i jedna tyrozyna stabilizująca oksoanion Y) na podstawie struktur aminopeptydazy N i astacyny, przeprowadzając projektowanie dwustronne zarówno sekwencji proteazy, jak i substratu, aby zapewnić precyzyjne położenie docelowego wiązania amidowego.

• Spośród 135 zaprojektowanych w jednej rundzie projektowania, 36% wykazało aktywność (14,7% dla modeli tylko z cynkiem i 87,5% dla modeli cynk-woda), przy czym wszystkie aktywne projekty rozcinały dokładnie w zamierzonych miejscach potwierdzonych spektrometrią masową; najbardziej aktywny projekt (Zn45 rozcinający substrat ZnO36) osiągnął kcat równy 0,025 ± 0,002 s⁻¹, KM równy 26 ± 5 μM, a kcat/KM równy 900 ± 200 M⁻¹s⁻¹, co stanowi >10⁸-krotne przyspieszenie tempa w porównaniu do niekatalizowanej hydrolizy; projekty wykazały wiązanie cynku z Kd między 10⁻¹⁰ a 10⁻⁸ M, wykazały specyfikę substratową w 4 z 5 rusztowań i mogły być przeprogramowane do rozkładu białka TDP-43 u ludzi, istotnego dla chorób, z 4 wariantami osiągającymi ≥80% rozkładu po 5 godzinach.

Autorzy: Hojae Choi i in. Donald Hilvert, Samuel J. Pellock, David Baker

Link:

607

Czy model językowy może nauczyć się struktury RNA bez wyraźnych danych treningowych dotyczących struktury?@NatureComms @Tsinghua_Uni

"ERNIE-RNA: model językowy RNA z wzmocnionymi reprezentacjami strukturalnymi"

• Istniejące modele językowe RNA pomijają informacje strukturalne w sekwencjach, co prowadzi do niekompletnego wydobywania cech i suboptymalnej wydajności, mimo hierarchicznej organizacji RNA, w której pierwotne sekwencje składają się w określone konformacje strukturalne, które determinują funkcje biologiczne. Tradycyjne podejścia obliczeniowe do przewidywania struktury RNA napotykają na wyraźne wyzwania: metody oparte na termodynamice są ograniczone przez dokładność parametrów, metody oparte na dopasowaniu mają trudności bez wystarczającej liczby homologicznych sekwencji, a modele głębokiego uczenia wykazują ograniczoną generalizację do nieznanych rodzin RNA. Podczas gdy modele językowe RNA w stylu BERT, takie jak RNA-FM (wytrenowane na 23 milionach sekwencji), UNI-RNA (1 miliard sekwencji, 400M parametrów) i RiNALMo (36M sekwencji, 650M parametrów) pojawiły się, nie są w stanie odpowiednio uwzględnić informacji strukturalnych, a niektóre, takie jak UTR-LM, próbują to zrobić, włączając przewidywane struktury z RNAfold, ale napotykają ograniczenia wynikające z błędów przewidywania i zmniejszonej zdolności do generalizacji.

• ERNIE-RNA to model językowy RNA z 86 milionami parametrów, wstępnie wytrenowany na podstawie zmodyfikowanej architektury BERT z 12 blokami transformatorowymi i 12 głowami uwagi, wytrenowany na 20,4 milionach sekwencji RNA niekodującego z RNAcentral po przefiltrowaniu sekwencji dłuższych niż 1022 nukleotydy i zastosowaniu usuwania redundancji CD-HIT przy 100% podobieństwa. Model wprowadza mechanizm uwagi oparty na parowaniu zasad, który przypisuje wartości 2 dla par AU, 3 dla par CG oraz regulowany parametr α (początkowo 0.8) dla par GU w macierzy pozycji par przeciwko sobie, zastępując termin bias w pierwszej warstwie transformatora. Wstępne szkolenie wykorzystało modelowanie językowe z maskowaniem, w którym 15% tokenów zostało losowo zastąpionych, trenowane przez 20 dni na 24 32G-V100 GPU przy użyciu fairseq z podstawową stopą uczenia 0.0001, 20 000 kroków rozgrzewających i 0.01 spadkiem wagi, generując zarówno mapy uwagi (L×L×156), jak i osadzenia tokenów (12×768×L) jako wyjścia.

• Mapy uwagi ERNIE-RNA wykazały zdolność przewidywania drugorzędowej struktury RNA w trybie zero-shot z medianą F1-score wynoszącą 0.552 na zbiorze testowym bpRNA-1m, przewyższając RNAfold (0.492), RNAstructure (0.491), RNAErnie (0.440) i RNA-BERT (0.365) bez dostrajania. Po dostrojeniu, ERNIE-RNA osiągnął stan na najwyższym poziomie makro-średnich F1-score wynoszących 0.873 na bpRNA-1m, przewyższając RiNALMo (0.850, 650M parametrów) i UNI-RNA (0.821, 400M parametrów), z podobnym przywództwem na ArchiveII (0.954 w porównaniu do 0.892 RiNALMo) i RIVAS TestSetB (0.721 w porównaniu do 0.555 RiNALMo). W trudnych testach generalizacji między rodzinami, ERNIE-RNA w trybie zamrożonym osiągnął F1-score wynoszące 0.646 na bpRNA-new i 0.590 na RNA3DB-2D, przewyższając tradycyjne metody programowania dynamicznego, takie jak Eternafold (0.639) i utrzymując przewagę nad wszystkimi konkurentami w głębokim uczeniu. ERNIE-RNA osiągnął również lepszą wydajność w różnych zadaniach downstream: przewidywanie map kontaktów RNA z precyzją Top-L/1 wynoszącą 0.68 (w porównaniu do zespołu RNAcontact na poziomie 0.46), przewidywanie MRL 5'UTR z R² wynoszącym 0.92 na losowym zbiorze testowym i 0.86 na zbiorze testowym dla ludzi, przewidywanie wiązania RNA-białko przewyższające wszystkie testowane metody, dokładności klasyfikacji rodzin ncRNA wynoszące 0.9844 (0% hałasu na granicy) i 0.9820 (200% hałasu na granicy), F1-score przewidywania miejsc splicingu w zakresie od 0.9180 do 0.9612 w czterech gatunkach, dokładność top-K wynosząca 55.37% na zbiorze danych SpliceAI (w porównaniu do 34.84% RNA-FM) oraz przewidywanie alternatywnej poliadenylacji z R² wynoszącym 78.39% (w porównaniu do 70.32% RNA-FM).

Autorzy: Weijie Yin, Zhaoyu Zhang, Shuo Zhang, Liang He i in. Xuegong Zhang, Tao Qin i Zhen Xie

Link:

632

Czy sztuczna inteligencja może projektować terapeutyczne peptydy, naśladując sposób, w jaki naturalne białka wiążą się z celami chorobowymi?@Tsinghua_Uni @natBME

"Projektowanie peptydów poprzez naśladownictwo interfejsu wiązania z PepMimic"

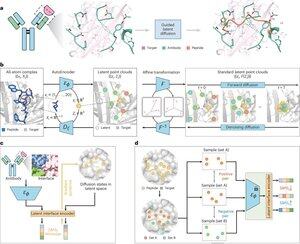

• Naukowcy opracowali PepMimic, algorytm AI łączący autoenkoder o pełnym atomie, model dyfuzji latentnej i enkoder interfejsu do projektowania peptydów (4-25 aminokwasów), które naśladują interfejsy wiązania między białkami docelowymi a znanymi wiązaczami, takimi jak przeciwciała czy receptory, rozwiązując ograniczenia w obecnym projektowaniu peptydów, które wymaga manualnej wiedzy i ma trudności z nieciągłymi powierzchniami wiązania.

• Ponad 80 terapeutycznych peptydów zostało zatwierdzonych w leczeniu chorób, w tym cukrzycy i nowotworów, oferując zalety takie jak wysoka specyficzność, niższa toksyczność i potencjalna możliwość podania doustnego w porównaniu do małych cząsteczek i biologików, jednak projektowanie peptydów naśladujących interakcje białko-białko tradycyjnie wymaga dużej wiedzy i nie radzi sobie skutecznie z nieciągłymi interfejsami wiązania, podczas gdy istniejące modele AI koncentrują się na podejściu „szkielet- następnie-sekwencja”, a nie na uchwyceniu kluczowej geometrii łańcuchów bocznych dla dokładnych interakcji aminokwasów.

• PepMimic został wytrenowany na 4 157 kompleksach białko-peptyd i 70 645 fragmentach podobnych do peptydów z bazy danych Protein Data Bank, wykorzystując autoenkoder do mapowania geometrii pełnoatomowej do przestrzeni latentnej, model dyfuzji do 100 kroków odszumiania oraz uczenie kontrastowe do trenowania enkodera interfejsu, który kieruje generowaniem, minimalizując odległości między zaprojektowanymi a referencyjnymi interfejsami w przestrzeni latentnej, a kandydaci są klasyfikowani przy użyciu energii interfejsu Rosetta, energii FoldX, metryk trafień interfejsu oraz wyników pLDDT AlphaFold Multimer przed wyborem najlepszych peptydów (384 dla celów z znanymi wiązaczami, 94-290 dla wiązaczy generowanych przez AI) do eksperymentów obrazowania rezonansu plazmonowego.

• PepMimic osiągnął średni AUROC wynoszący 0,71 w 31 zadaniach na 93 testowych kompleksach (przewyższając RFDiffusion z wynikiem 0,69), zaprojektował 384 peptydy dla 5 celów lekowych (PD-L1, CD38, BCMA, HER2, CD4), z 8% osiągających KD < 100 nM i 26 peptydami osiągającymi KD na poziomie 10⁻⁹ M (znacznie wyżej niż w przypadku losowego skanowania biblioteki), wygenerował peptydy naśladujące wiązaczy zaprojektowanych przez AI dla CD38 i TROP2 z 14% wskaźnikiem sukcesu (16% dla CD38, 8% dla TROP2) oraz wykazał skuteczne celowanie w guzy in vivo w modelach myszy, z wybranymi peptydami wykazującymi 8,85-krotnie większe wchłanianie w guzach pozytywnych na PD-L1 i 16,18-krotnie większe wchłanianie w guzach pozytywnych na TROP2, osiągając wskaźniki sukcesu 20 000-90 000 razy wyższe niż w przypadku eksperymentalnego losowego skanowania biblioteki.

Autorzy: Xiangzhe Kong i in. Zihua Wang, Yang Liu i @musicsuperman

Link:

1,24K

Najlepsze

Ranking

Ulubione