Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

DailyHealthcareAI

Împărtășirea lucrărilor de cercetare și a știrilor despre aplicațiile AI în radiologie, patologie, genetică, design de proteine și multe altele. Să învățăm împreună!

🚀Preprintul lui David Baker de la @UWproteindesign 👇👇

Ce face tăierea legăturilor proteice atât de dificilă încât natura a dezvoltat enzime specializate cu cofactori metalici pentru a realiza acest lucru@biorxivpreprint @ETH_en

"Proiectarea computațională a proteazelor de cisteină"

• Legăturile amidice din proteine au timpi de înjumătățire de sute de ani în condiții fiziologice, făcându-le mult mai stabile decât legăturile estere (cu grupuri care lasă aminele având pKa >35 față de <8 pentru esterii activați), iar proiectarea anterioară a enzimelor computaționale a avut succes doar cu substraturi esteri mici cu molecule mici activate, în loc de clivajarea energetic solicitantă a legăturilor peptidice necesară pentru proteaze.

• Cercetătorii au folosit RoseTTAFold Diffusion 2 for Molecular Interfaces (RFD2-MI) pentru a proiecta proteaze de zinc pornind de la motive catalitice minime, construind un sit activ ideal cu cinci grupuri funcționale (trei reziduuri de legare de zinc H1, H2, E1, o bază catalitică E2 și o tirozină Y stabilizantă oxianion) bazate pe structuri de aminopeptidază N și astacină, realizând proiectarea bilaterală atât a proteazei, cât și a secvențelor substratului pentru a asigura poziționarea precisă a legăturii amidice țintă.

• Din cele 135 de proiecte testate într-o singură rundă de proiectare, 36% au arătat activitate (14,7% pentru modelele doar Zn și 87,5% pentru modelele Zn-apă), toate designurile active fiind tăiate exact la locațiile vizate confirmate prin spectrometrie de masă; cel mai activ proiect (substratul Zn45 care despică ZnO36) a atins kcat de 0,025 ± 0,002 s⁻¹, KM de 26 ± 5 μM și kcat/KM de 900 ± 200 M⁻¹s⁻¹, reprezentând o accelerație de >10⁸ ori față de hidroliza necatalizată; Proiectele au prezentat legare de zinc cu Kd între 10⁻¹⁰ și 10⁻⁸ M, au arătat specificitate a substratului în 4 din cele 5 schele și au putut fi reprogramate pentru a corder proteina umană TDP-43 relevantă pentru boala de scindere, cu 4 variante care au obținut o clivagare de ≥80% la 5 ore.

Autori: Hojae Choi și al Donald Hilvert, Samuel J. Pellock, David Baker

Legătură:

610

Poate un model de limbaj să învețe structura ARN-ului fără date explicite de antrenament structural?@NatureComms @Tsinghua_Uni

"ERNIE-ARN: un model de limbaj ARN cu reprezentări îmbunătățite de structură"

• Modelele existente de limbaj ARN trec cu vederea informațiile structurale din secvențe, ceea ce duce la extragerea incompletă a caracteristicilor și performanțe suboptime, în ciuda organizării ierarhice a ARN-ului, unde secvențele primare se pliază în conformații structurale specifice care determină funcțiile biologice. Abordările computaționale tradiționale pentru predicția structurii ARN-ului se confruntă cu provocări distincte: metodele bazate pe termodinamică sunt limitate de acuratețea parametrilor, metodele bazate pe aliniere se confruntă cu dificultăți fără secvențe omologe suficiente, iar modelele de învățare profundă prezintă o generalizare limitată către familii de ARN nevăzute. Deși modele de limbaj ARN în stil BERT precum RNA-FM (antrenat pe 23 de milioane de secvențe), UNI-RNA (1 miliard de secvențe, 400M parametri) și RiNALMo (36M secvențe, 650M parametri), ele nu reușesc să încorporeze adecvat informațiile structurale, unele precum UTR-LM încercând să rezolve această problemă prin integrarea structurilor prezise din RNAfold, dar confruntându-se cu limitări din cauza erorilor de predicție și a capacității reduse de generalizare.

• ERNIE-RNA este un model de limbaj pre-antrenat cu ARN cu 86 de milioane de parametri, bazat pe arhitectură BERT modificată, cu 12 blocuri transformatoare și 12 capete de atenție, antrenat pe 20,4 milioane de secvențe ARN necodificante de la RNAcentral după filtrarea secvențelor mai lungi de 1022 nucleotide și aplicarea eliminării redundanței CD-HIT cu o similaritate de 100%. Modelul încorporează un mecanism de bias de atenție informat de împerechere de bază, care atribuie valori de 2 pentru perechile AU, 3 pentru perechile CG și un parametru reglabil α (inițial 0,8) pentru perechile GU într-o matrice de poziții pereche cu pereche all-counter-all, înlocuind termenul de polarizare din primul strat transformator. Pre-antrenamentul a folosit modelare a limbajului mascat cu 15% din tokenuri înlocuite aleatoriu, antrenat timp de 20 de zile pe 24 GPU-uri 32G-V100 folosind fairseq cu rata de învățare de bază 0,0001, 20.000 de pași de încălzire și 0,01 weight decay, generând atât hărți de atenție (L×L×156), cât și embeddings de tokenuri (12×768×L) ca ieșiri.

• Hărțile de atenție ale ERNIE-RNA au demonstrat capacitatea de predicție a structurii secundare a ARN-ului zero-shot, cu un scor median F1 de 0,552 pe setul de testare bpRNA-1m, depășind RNAfold-ul (0,492), structura ARN-ului (0,491), RNAErnie (0,440) și ARN-BERT (0,365) fără reglare fină. După reglaje fine, ERNIE-RNA a atins scoruri macro-medii F1 de ultimă generație de 0,873 pe bpRNA-1m, depășind RiNALMo (0,850, parametri 650M) și UNI-RNA (0,821, parametri 400M), cu un leadership similar pe ArchiveII (0,954 față de 0,892 la RiNALMo) și RIVAS TestSetB (0,721 față de 0,555 la RiNALMo). În testele provocatoare de generalizare cross-family, ERNIE-RNA congelat a obținut scoruri F1 de 0,646 pe bpRNA-new și 0,590 pe RNA3DB-2D, depășind metodele tradiționale de programare dinamică precum Eternafold (0,639) și menținând superioritatea față de toți concurenții în învățare profundă. ERNIE-ARN a obținut, de asemenea, performanțe superioare în diverse sarcini ulterioare: predicția hărții de contact ARN-ul cu precizie Top-L/1 de 0,68 (comparativ cu ansamblul RNAcontact de 0,46), predicția MRL 5'UTR cu R² de 0,92 pe setul de testare aleatorie și 0,86 pe setul de testare umană, predicția legării ARN-proteine care a depășit toate metodele testate, acuratețe de clasificare a familiei ncRNA de 0,9844 (0% zgomot de frontieră) și 0,9820 (zgomot de frontieră de 200%), Scoruri F1 pentru predicția locului de splicare variind între 0,9180 și 0,9612 la patru specii, acuratețe top-K de 55,37% pe setul de date SpliceAI (față de 34,84% la RNA-FM) și predicție alternativă a poliadenilării R² de 78,39% (față de 70,32% la RNA-FM).

Autori: Weijie Yin, Zhaoyu Zhang, Shuo Zhang, Liang He etc. al Xuegong Zhang, Tao Qin & Zhen Xie

Legătură:

635

Poate inteligența artificială să proiecteze peptide terapeutice imitând modul în care proteinele naturale se leagă de țintele bolii@Tsinghua_Uni @natBME

"Proiectarea peptidelor prin mimetismul interfeței de legare cu PepMimic"

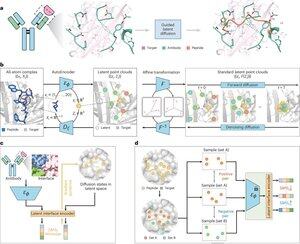

Cercetătorii au dezvoltat PepMimic, un algoritm AI care combină un autocodificator cu toți atomii, un model de difuzie latentă și un codificator de interfață pentru a proiecta peptide (4-25 de aminoacizi) care imită interfețele de legare dintre proteinele țintă și lianții cunoscuți, cum ar fi anticorpii sau receptorii, abordând limitările în proiectarea actuală a peptidelor care necesită expertiză manuală și se luptă cu suprafețele de legare discontinue.

• Peste 80 de terapii peptidice sunt aprobate pentru boli precum diabetul și cancerul, oferind avantaje precum specificitate ridicată, toxicitate mai mică și administrare orală potențială în comparație cu moleculele mici și produsele biologice geometrie pentru interacțiuni precise cu aminoacizi.

• PepMimic a fost antrenat pe 4.157 de complexe proteină-peptidă și 70.645 de fragmente asemănătoare peptidelor din Protein Data Bank, folosind un autocodificator pentru a mapa geometriile tuturor atomilor în spațiul latent, un model de difuzie pentru 100 de pași de eliminare a zgomotului și învățarea contrastivă pentru a antrena un codificator de interfață care ghidează generarea prin minimizarea distanțelor dintre interfețele proiectate și de referință în spațiul latent, candidații fiind clasificați folosind energia interfeței Rosetta, Energia FoldX, valorile de impact ale interfeței și AlphaFold Multimer pLDDT scoruri înainte de a selecta peptidele de top (384 pentru ținte cu lianți cunoscuți, 94-290 pentru lianții generați de AI) pentru experimente de imagistică prin rezonanță plasmonică de suprafață.

• PepMimic a obținut AUROC mediu de 0,71 în 31 de sarcini pe 93 de complexe de testare (depășind RFDiffusion 0,69), a proiectat 384 de peptide pentru 5 ținte de medicamente (PD-L1, CD38, BCMA, HER2, CD4) cu 8% atingând KD < 100 nM și 26 de peptide atingând KD la nivelul de 10⁻⁹ M (substanțial mai mare decât screeningul aleatoriu al bibliotecii), a generat peptide care imită lianți proiectați de AI pentru CD38 și TROP2 cu o rată de succes de 14% (16% pentru CD38, 8% pentru TROP2) și a demonstrat o țintire eficientă a tumorilor in vivo în modele de șoareci cu peptide selectate care prezintă o absorbție de 8,85 ori mai mare în tumorile PD-L1 pozitive și de 16,18 ori mai mare în tumorile TROP2 pozitive, obținând rate de succes de 20.000-90.000 de ori mai mari decât screeningul experimental aleatoriu al bibliotecii.

Autori: Xiangzhe Kong et. al Zihua Wang, Yang Liu și @musicsuperman

Legătură:

1,24K

Limită superioară

Clasament

Favorite